En termodinámica se habla con frecuencia de la entropía, pero ¿sabes qué es?, ¿cuáles son sus características?, ¿conoces algunos ejemplos de la vida cotidiana? Esto y más lo hablamos en este artículo.

Definición de entropía

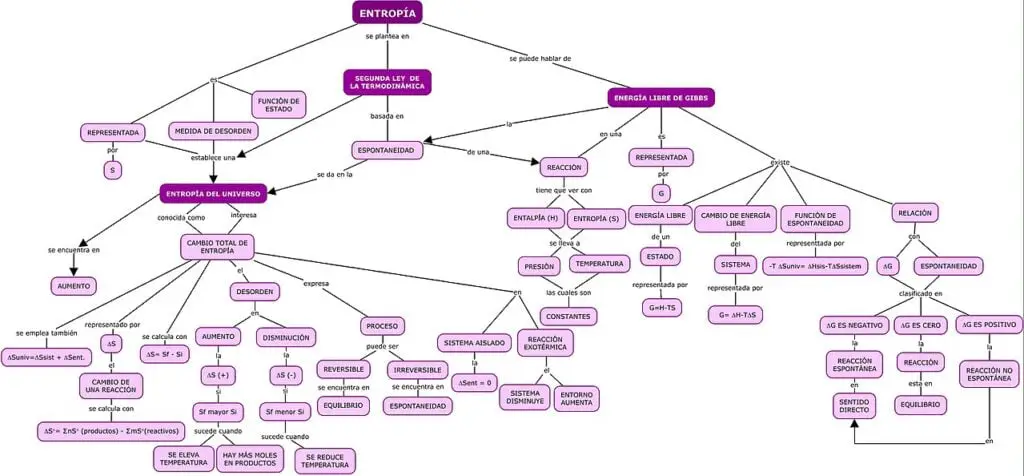

La entropía es una medida de la energía no disponible en un sistema termodinámico cerrado que también suele considerarse una medida del trastorno del sistema, una propiedad del estado del sistema que varía directamente con cualquier cambio reversible de calor en el sistema e inversamente con la temperatura del sistema.

Dicho en términos más sencillos, es la degradación de la materia y la energía en el universo a un estado último de uniformidad inerte.

Características

Sus tres principales características son las siguientes:

- Aumenta cuando el calor se suministra independientemente del hecho de que la temperatura cambie o no.

- Si la temperatura cambia o no, la entropía disminuye cuando se rechaza el calor.

- En todos los procesos adiabáticos, se mantiene constante.

Cómo se mide

Hay que tener mucho cuidado con la entropía, tanto midiéndola como en concepto. Cuando se mide la entropía, se deben tomar decisiones arbitrarias, algunas pueden ser evitadas, como la unidad de granularidad, tomando lo que se denomina tasa de Entropía, pero algunas otras limitaciones son insuperables.

Por ejemplo, uno tiene que hacer una elección arbitraria sobre cómo describir los eventos porque la entropía no es invariable en la forma en que puede describir el mismo objeto.

Y esto es incluso una limitación mucho mayor a la limitación común y generalmente reconocida de que para medir la entropía y tener sentido tiene que conocer el dominio del problema, es decir, todos los demás objetos o eventos en el conjunto de intereses y su distribución a la que entropía tampoco es independiente.

La entropía es, sin embargo, una función extremadamente simple, básicamente cuenta (con un logaritmo involucrado) la cantidad de cosas que tienen cierta propiedad o la cantidad de características de interés, y nada más.

En resumen, si bien la entropía es una medida interesante, que originalmente pretendía cuantificar solo el tamaño de un canal de comunicación, no es una propiedad intrínseca de un objeto o evento, ya que depende de una distribución.

Además, puede dar valores contradictorios a medida que cambia la descripción del mismo objeto, sin perder ni nada de información en las descripciones. Por lo tanto, es una medida muy frágil y no universal que se ha utilizado y abusado en gran medida.

Cómo calcularla

Se le representa con la letra S, y no puede calcularse en términos absolutos, por lo tanto, lo que se hace es calcular el aumento de entropía de un sistema en un determinado proceso termodinámico.

Cuando un sistema termodinámico recibe una cantidad de calor (Q) a una temperatura (T), se dice que ha sufrido un aumento de entropía que se calcula mediante la fómula:

∆S = Q/T

Sin embargo, debido a que en una transformación termodinámica la temperatura varía durante el proceso se requiere la aplicación del cálculo integral para calcular la etropía de dicho proceso.

La entropía y la segunda ley de la termodinámica

Los cambios químicos y físicos en un sistema pueden estar acompañados por un aumento o una disminución del trastorno del sistema, que corresponde a un aumento (S> 0) o una disminución en la entropía (S <0), respectivamente.

Al igual que con cualquier otra función de estado, el cambio en la entropía se define como la diferencia entre las entropías de los estados final e inicial: ΔS = Sf – Si.

Cuando un gas se expande en el vacío, su entropía aumenta porque el aumento del volumen permite un mayor desorden atómico o molecular. Cuanto mayor sea el número de átomos o moléculas en el gas, mayor será el desorden.

La magnitud de la entropía de un sistema depende de la cantidad de estados microscópicos, o microestados, asociados con él (en este caso, la cantidad de átomos o moléculas); es decir, cuanto mayor sea el número de microestados, mayor será la entropía.

Ejemplo: Mazo de cartas

Podemos ejemplificar los conceptos anteriores utilizando una baraja de cartas. En cualquier mazo nuevo, las 52 cartas están organizadas por cuatro palos, con cada palo ordenado en orden descendente.

Sin embargo, si se barajan, hay aproximadamente 1068 formas diferentes de organizarlas, lo que corresponde a 1.068 estados microscópicos diferentes.

La entropía de un nuevo mazo de cartas ordenado es baja, mientras que la de un mazo aleatorio es alta. Los juegos de cartas asignan un valor más alto a una mano que tiene un bajo grado de desorden.

En juegos como el póker de cinco cartas, solo 4 de las 2.598.960 manos diferentes posibles, o microestados, contienen la disposición altamente ordenada y valorada de las cartas llamada escalera real, casi 1.1 millones de manos contienen un par, y más de 1.3 millones de manos son completamente desordenados y por lo tanto no tienen valor.

Debido a que los dos últimos arreglos son mucho más probables que el primero, el valor de una mano de póquer es inversamente proporcional a su entropía.

Importancia de la entropía

Las leyes de la termodinámica, el principio subyacente de la acción mínima y la entropía son algo bueno, porque ayudan a mantener estable nuestro universo.

De lo contrario, los átomos de hidrógeno, las estrellas, los planetas rocosos, los microbios y las formas de vida sapientes no serían posibles.

Desventaja de la entropía

La entropía, en general, es, en un sistema cerrado, progresiva y aumenta con el tiempo. En el mejor de los casos, puede mantenerse constante, pero normalmente aumenta con el tiempo y la complejidad.

A medida que aumenta, la energía disminuye hasta que el sistema se encuentra en equilibrio y la temperatura se distribuye uniformemente.

Los sistemas tienden a pasar de un estado inferior de entropía a un estado superior con una complejidad creciente hasta que el sistema llega al equilibrio, y no puede ocurrir ninguna otra complejidad.

Entonces, su principal desventaja es que no es espontáneamente reversible en el tiempo. Si lo fuera, los eventos se moverían hacia atrás en el tiempo.

Ejemplos de entropía

Vemos evidencia de que el universo tiende a la entropía más alta en muchos lugares de nuestras vidas.

Una fogata es un ejemplo. La madera sólida se quema y se convierte en ceniza, humo y gases, todos los cuales distribuyen la energía hacia el exterior con mayor facilidad que el combustible sólido.

El derretimiento del hielo, la disolución de sal o azúcar, la fabricación de palomitas de maíz y el agua hirviendo para el té son procesos cotidianos de entropía en la cocina.